23 Mai 2019

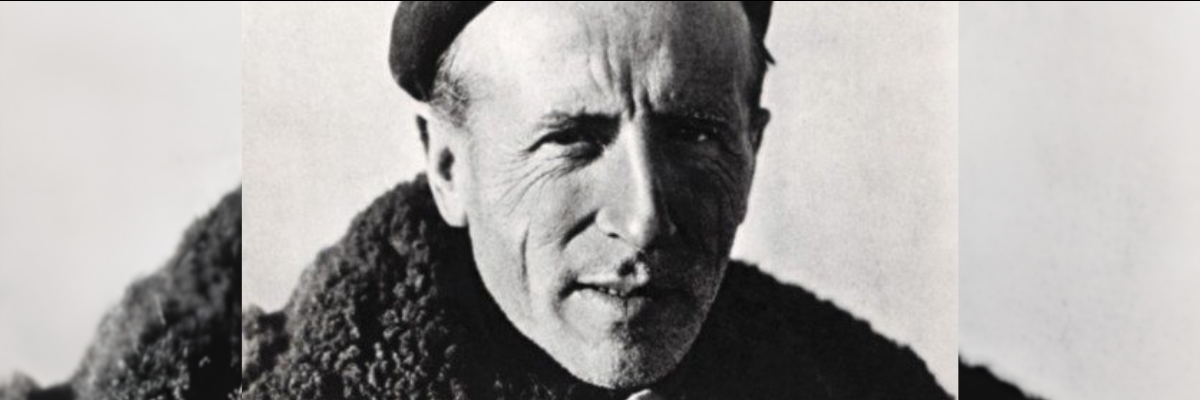

- Nick Bostrom, professor de filosofia na Universidade de Oxford, é especialista nos riscos representados pela inteligência artificial.

- Bostrom, cujo trabalho foi apoiado por Elon Musk e Bill Gates, declarou ao Business Insider que a IA é "uma ameaça maior para a existência humana do que as mudanças climáticas".

- Ele afirma que "seria demais esperar" que todas as grandes empresas de tecnologia, como Google e Facebook, criarão seus próprios sistemas éticos para a inteligência artificial.

- Bostrom também disse que acredita que deveria haver mais pessoas com conhecimento básico de IA nos governos.

Um dos principais pensadores em nível mundial sobre inteligência artificial afirma que a tecnologia é uma ameaça maior à civilização do que as mudanças climáticas.

A reportagem é de Charlie Wood, publicada por Business Inside Itália, 22-05-2019. A tradução é de Luisa Rabolini.

Nick Bostrom, professor de filosofia em Oxford, declarou ao Business Insider: "A inteligência artificial (IA) é uma ameaça maior para a existência humana do que a mudança climática: a mudança climática não será a maior reviravolta que veremos neste século".

Ele acrescentou: "É improvável que a mudança climática leve a um bom resultado, mas se o desenvolvimento da IA for negativo, será muito pior do que as mudanças climáticas: a inteligência artificial poderia se revelar como algo realmente positivo para a humanidade, mas poderia também ter consequências muito graves”.

Bostrom é um pensador proeminente em seu campo, tendo publicado livros incluindo Superinteligência. Tendências, perigos, estratégias.

Ele também se diferencia dos demais porque apela para ambos os lados do debate: seu trabalho foi apoiado por Elon Musk, que expressou opiniões apocalípticas sobre a IA, e Bill Gates, um cauteloso defensor da tecnologia.

É por isso que ele tem o cuidado de explicar sua comparação com as mudanças climáticas, uma força que poderia prejudicar a Terra irrevogavelmente a menos que os seres humanos façam mudanças radicais na próxima década.

"A razão pela qual a inteligência artificial é muitas vezes representada como um robô maligno na mídia é porque serve para contar melhor a história: os robôs são visualmente mais convincentes do que um chip dentro de uma caixa preta, você pode vê-los e ouvi-los de uma forma que não seria possível fazer com um chip", disse ele. "Mas o mal não é o problema, é a possibilidade de que a IA seja indiferente aos objetivos humanos."

Todas as entidades inteligentes, tanto humanas quanto artificiais, têm objetivos, mesmo que sejam pré-programadas. Para os simples termômetros IA, por exemplo, consiste em medir a temperatura com sucesso.

O medo de Bostrom é que, se as IAs se tornam suficientemente competentes em perseguir seus objetivos, mesmo aqueles que parecerem inofensivos, poderiam, inadvertidamente, prejudicar as pessoas.

Em um artigo de 2003, Bostrom deu o exemplo de uma IA cujo único objetivo é de maximizar a produção de clipes.

Se essa IA conseguisse reprogramar a si mesma para melhorar sua inteligência - algo que algumas IAs desenvolvidas pela Google já podem fazer -, ela poderia se tornar tão inteligente a ponto de inovar as modalidades através das quais maximiza o número de clipes que ela produz.

Em determinado ponto, ela poderia começar a "transformar toda a terra primeiro e depois aumentar as porções de espaço ocupadas por instalações de produção de clipes", escreveu Bostrom.

Se transformar o mundo em um clipe parece uma coisa idiota, é porque não se alinha com os objetivos dos seres humanos. Mas a máquina que produz clipes está seguindo seus objetivos devido a uma conclusão lógica.

Ao se tornar tão incrivelmente eficiente em produzir clipes, poderia acabar prejudicando as pessoas. Não se revelaria uma máquina malvada, mas simplesmente indiferente aos objetivos que vão além de seus próprios.

O exemplo poderia parecer improvável, mas Bostrom afirma que a indiferença da IA em relação aos objetivos da humanidade poderia já ser uma ameaça real.

"As formas mais pesadas em que a IA pode ter um impacto negativo são os papéis dos sistemas de informação, como a seleção de notícias que confirmam os preconceitos das pessoas ou que atuam como sistemas de vigilância", afirmou ele.

Os problemas já estão surgindo com este último caso, levando as pessoas a se perguntarem se empresas como Amazon e Microsoft deveriam vender a tecnologia de reconhecimento facial a agências governamentais.

A American Civil Liberties Union declarou em maio passado que a Amazon havia vendido sua ferramenta Rekognition às agências governamentais e policiais com o propósito de vigilância pública e identificação de "pessoas de interesse". A ACLU também descobriu no ano passado que a Rekognition tinha identificado erroneamente 28 membros do Congresso como pessoas que haviam sido presas.

Para Bostrom, o grande desafio é controlar a inteligência artificial e programá-la para alinhá-la aos objetivos humanos.

"A primeira série de dificuldades será técnica, como encontrar uma maneira de desenvolver a inteligência artificial de maneira controlada", explicou. "Assumindo que resolvamos isso, nossos objetivos subsequentes são as dificuldades sociais relacionadas à criação de uma ordem mundial que esteja ao serviço do bem comum".

As grandes empresas de tecnologia estão tendo dificuldade em entender como tornar a inteligência artificial segura.

Mas Bostrom considera que as grandes empresas de tecnologia estão se empenhando o suficiente para desenvolver a inteligência artificial de maneira controlada? Google, Amazon, Facebook e Apple estão na vanguarda do desenvolvimento da IA, mas alguns estudiosos acreditam que não estão desenvolvendo uma IA compatível com os objetivos humanos.

Bostrom disse que as pessoas com quem ele havia conversado nas grandes empresas de tecnologia "estão preocupadas e empenhadas em tornar a AI segura e compatível" com esses objetivos.

"Eu também tenho a sensação de que eles não estejam em condições de entender o que fazer para conseguir isso", disse. "Seria demais esperar" que cada empresa de tecnologia apresente seu próprio quadro ético para o controle da IA".

As empresas de tecnologia estão claramente envolvidas com esse problema. A Google, por exemplo, dissolveu um conselho de ética sobre a IA uma semana depois que milhares de funcionários participaram da campanha contra a inclusão de Kay Coles James, presidente da Fundação Heritage, um think tank de direita.

Mas se não podemos confiar nas grandes empresas de tecnologia para criar trilhos para o desenvolvimento ético e seguro da IA, em quem poderemos confiar? E os governos? Mais uma vez, Bostrom é cético.

"Ainda não há muitas propostas políticas claras sobre como os governos deveriam intervir", ele explicou. "Neste momento, não está claro o que gostaríamos que os governos fizessem. Precisamos ampliar o debate. O capitalismo deveria trabalhar com governos que criam as regras de comportamento e as empresas que trabalham dentro de tais regras", acrescentou, mas "há um desequilíbrio cultural entre a Silicon Valley e os governos: a Silicon Valley tem um ethos orientado à liberdade, enquanto os governos estão muito atrasados e não têm impulso empreendedor".

Ele acrescentou: "Penso que haverá uma necessidade nos governos de mais especialistas em inteligência artificial - não necessariamente pesquisadores brilhantes, mas pessoas com alguma experiência, como um pós-graduado em informática. A capacidade de compreender a inteligência artificial passa por graus. Às vezes é melhor não ser muito especializado, porque se você for muito especializado, pode ter uma visão estreita das ramificações sociais mais amplas de um campo".

Bostrom, no entanto, acredita que pode moldar a conversa em torno da IA mesmo permanecendo dentro do mundo acadêmico. Também disse que funcionários ativistas, como os da Google, desempenharam seu papel em fazer com que suas empresas sentissem o peso das responsabilidades.

"Há coisas que os pesquisadores de IA podem fazer para influenciar o comportamento das grandes empresas de tecnologia sem ter que deixar o mundo acadêmico", disse ele. "Existe também um grau de ativismo público dentro das comunidades de pesquisa sobre a IA, como a recente revolta da Google”.

Leia mais

- "Os humanos serão responsáveis por sua própria extinção". Entrevista com Nick Bostrom

- Instituto britânico alerta para riscos de extinção da raça humana

- Inteligência artificial e práticas cotidianas

- Elon Musk: “A inteligência artificial ameaça a existência da nossa civilização”

- Elon Musk e mais de cem líderes em tecnologia pedem proibição de 'robôs assassinos'

- ''Machine Behaviour'' e Inteligência Artificial: nomear os medos, governar os algoritmos. Artigo de Paolo Benanti

- Especialistas em inteligência artificial advertem sobre a 'corrida armamentista da tecnologia' em Roma

- Máquinas Sapiens. Os desenvolvimentos da Inteligência Artificial

- “Precisamos da inteligência artificial para sobreviver como espécie”

- O irreversível avanço da inteligência artificial

- Agência de notícias do governo chinês cria um “Apresentador com Inteligência Artificial” que parece humano (mas não é)

- Quais são os perigos da inteligência artificial em nosso admirável mundo novo de carros autônomos?

- Ética e Inteligência Artificial. Dez áreas de interesse

- “Estamos perto de uma revolução tão grande quanto o smartphone”, diz criador da Siri

- Sistemas de inteligência artificial - Desafios e perspectivas. Entrevista especial com Claudio Jung

- Como você é espionado por seu celular Android sem saber

- Inteligência artificial - A disputa entre a busca da eficiência e os desafios ético-morais. Entrevista especial com Brian Green

- “Os robôs não se levantarão contra nós, são meras ferramentas”, afirma Jerry Kaplan

- O pessoal é digital. Artigo de Slavoj Žižek